Nouvelles

Ce que nous avons vu cette année à la conférence Computer Vision and Pattern Recognition 2023 : Première partie

(Crédit : twitter.com/cvpr)

Des membres de l'équipe d'Amii ont récemment assisté à la Conférence sur la vision informatique et la reconnaissance des formes (CVPR), parrainée par la Computer Vision Foundation (CVF) et l'Institute for Electrical and Electronics Engineers (IEEE). La conférence CVPR est sans doute la principale conférence annuelle dans le domaine de la vision par ordinateur et de l'intelligence artificielle. Dans la première partie ci-dessous, nous présentons les enseignements que l'équipe a tirés des ateliers et des présentations principales. Dans la deuxième partie, nous approfondirons les tendances et les avancées récentes qui ont retenu notre attention.

Introduction et conclusions de la conférence

Cette année, la CVPR s'est tenue à Vancouver et a accueilli plus de 10 000 participants, dont la grande majorité en personne. Pour la deuxième année seulement après le passage à un cadre essentiellement virtuel en raison de la pandémie, la conférence a suscité un mélange d'impatience et de légère inquiétude. Les participants étaient impatients de reprendre contact en personne, surmontant ainsi une certaine gêne due à une période prolongée d'interactions uniquement numériques. En outre, les chercheurs se sont trouvés à un carrefour technologique poignant. S'ils étaient enthousiasmés par les progrès de l'IA générative, ils craignaient en même temps que l'escalade des exigences informatiques de ces technologies ne laisse la communauté universitaire à la traîne.

La conférence a débuté par deux journées intenses de tutoriels et d'ateliers simultanés couvrant des sujets très divers, allant de la pratique (par exemple, les voitures autonomes) à la théorie (par exemple, les fondements des réseaux neuronaux).

L'atelier " Scholars and Big Models - How Can Academic Adapt ", qui a attiré de nombreux participants, a donné lieu à des présentations par d'éminents chercheurs tels que Jitendra Malik et Jon Barron. Jitendra a souligné l'importance de ne pas confondre "grande science" et "petite science" et "université" et "industrie" et a fait des remarques encourageantes sur le rôle futur de l'université dans le nouvel écosystème des grands modèles. Jon est allé plus loin en proposant des orientations spécifiques (liées à l'infographie) pour la recherche universitaire future, mais il a conclu que les grands modèles semblent offrir des avantages significatifs, ce qui désavantage le monde universitaire s'il ne collabore pas étroitement avec l'industrie.

En tant que chercheur en IA appliquée constamment à la recherche de nouveaux problèmes à résoudre, il était rafraîchissant de voir que nous ne sommes pas les seuls à avoir les mêmes préoccupations concernant l'augmentation constante de la taille des modèles et des exigences en matière de calcul. Les paroles de sagesse émanant de chercheurs très expérimentés, dont beaucoup ont connu plusieurs perturbations de ce type dans le domaine, sont arrivées à point nommé. Toutefois, compte tenu des différences marquées entre les prévisions (et les stratégies proposées pour se préparer) à l'avenir de l'IA, seul l'avenir nous dira comment le domaine évoluera et à quoi ressembleront nos rôles à l'avenir.

La conférence principale a été marquée par la présence de trois conférenciers exceptionnels. Le premier jour, Rodney Brooks a emmené le public dans un voyage historique, citant nombre de ses expériences personnelles et partageant ses idées sur le thème "Revisiter de vieilles idées avec du matériel moderne". À notre grande surprise, il a donné un exemple historique de l'engouement pour l'IA (bien connu) sous la forme du sous-titre de l'un des articles fondateurs de Rosenblatt publié en 1958 : "Introducing the perceptron - A machine which senses, recognizes, remembers, and responds like the human mind" (Introduction au perceptron - Une machine qui sent, reconnaît, se souvient et réagit comme l'esprit humain). Il a rappelé aux chercheurs que "les idées reviennent sans cesse et donnent parfois de meilleurs résultats". Il a terminé son intervention en encourageant les jeunes chercheurs à aller au-delà de ce qui est à la mode et a proposé que "revenir à de vieilles idées pourrait être fructueux en présence d'un calcul massif". Cela correspond bien à ma propre intuition, à savoir que l'histoire contient souvent des indices précieux sur l'avenir d'un domaine et que les jeunes chercheurs devraient éviter le piège de trop se concentrer sur les tendances les plus chaudes et les plus récentes.

Le deuxième jour, Yejin Choi a présenté un exposé divertissant et perspicace intitulé "An AI Odyssey : the Dark Matter of Intelligence" (Une odyssée de l'IA : la matière noire de l'intelligence), dans lequel elle a réfléchi aux futurs possibles de la recherche sur l'IA et présenté certains de ses travaux rafraîchissants, sobres et rigoureux, sur l'étude des limites des grands modèles de langage (LLM) en matière de compositionnalité, jetant le doute sur le fait que les transformateurs modernes sont suffisants pour atteindre l'intelligence générale artificielle (AGI). Elle a fait part d'un point de vue important, à savoir que "la génération est plus facile que la compréhension pour l'IA actuelle. Pour les humains, il semble que ce soit l'inverse. Nous avons apprécié son analyse minutieuse et rigoureuse des lacunes des derniers modèles LLM. La compositionnalité est un élément essentiel de l'intelligence et le fait d'établir que les transformateurs ne sont peut-être pas les bons outils pour ce travail est une invitation à rechercher des alternatives plus prometteuses, peut-être dans l'histoire du domaine (par exemple, les systèmes neuro-symboliques) ou en traçant de nouveaux territoires.

Le dernier jour, Larry Zitnick a présenté un exposé passionnant sur lamodélisation des atomes pour résoudre la crise climatique, dans lequel il explique que les chercheurs en vision artificielle pourraient utiliser leurs compétences pour résoudre des problèmes de chimie, par exemple la découverte de matériaux, de nouvelles batteries, la dépollution des déchets dangereux, etc. Il a présenté le projet Open Catalyst, un concours NeurIPS qui en est à sa troisième itération et qui vise à encourager les chercheurs à unir leurs forces en s'efforçant d'améliorer les performances d'un nouvel ensemble de données ouvert et massif par rapport aux critères de référence actuels. En tant que scientifiques, nous avons trouvé cet exposé particulièrement inspirant. La perspective de développer des modèles d'IA au service du progrès scientifique (en l'occurrence la chimie et la science des matériaux) est incroyablement excitante. Ce n'est que relativement récemment que les applications réelles de l'IA ont dépassé le cadre du commerce électronique et de la publicité pour avoir un impact réel sur la science et l'ingénierie.

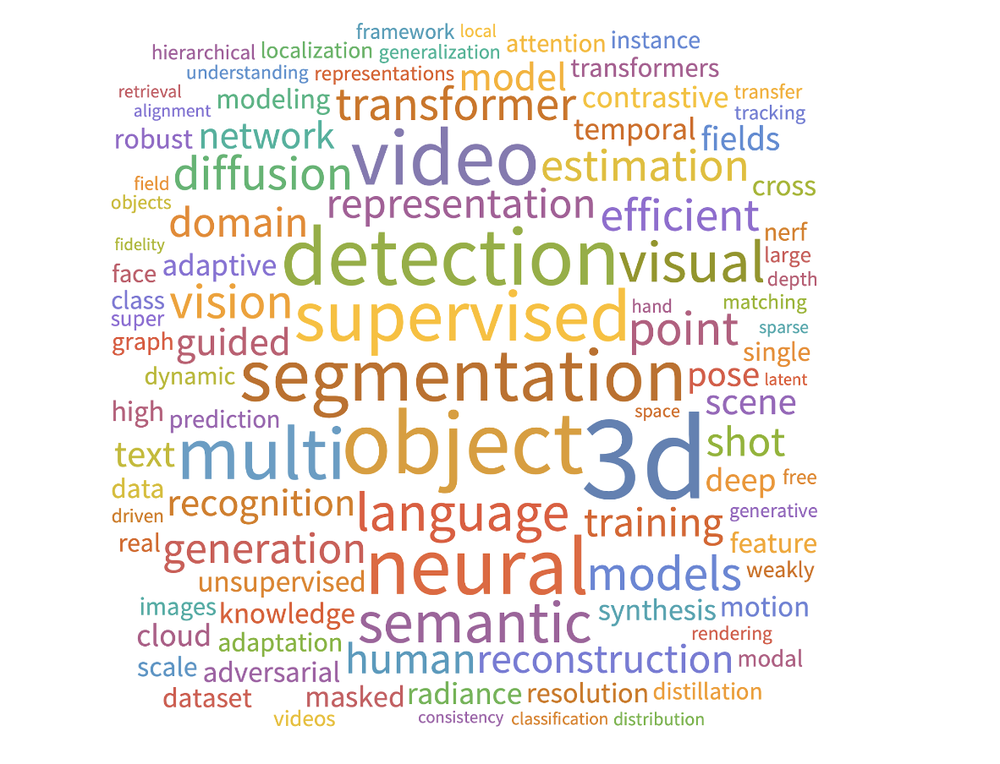

Chaque jour comprenait deux sessions de posters avec environ 400 posters par session ! Il est impossible de faire un résumé exhaustif de tous les travaux importants présentés, mais dans la deuxième partie de cette série, nous tenterons de creuser un peu plus pour mettre en évidence les tendances et identifier les travaux novateurs qui ont retenu notre attention.

Derniers articles d'actualité

24 juillet 2024

Nouvelles

Les humains améliorent l'IA avec Matt Taylor | Approximately Correct Podcast

Comment obtenir les meilleurs résultats lorsque l'IA et les êtres humains travaillent ensemble ? Dans cet épisode d'Approximately Correct, nous nous penchons sur l'IA en boucle avec Matt Taylor, boursier de l'Amii et titulaire de la chaire d'IA du CIFAR au Canada.

22 juillet 2024

Nouvelles

Nouvelles mensuelles d'Amii - Juillet 2024

Lisez notre mise à jour mensuelle sur la croissance de l'écosystème de l'intelligence artificielle en Alberta et sur les possibilités d'y participer.

18 juillet 2024

Nouvelles

Donner du pouvoir aux fondateurs : La collaboration entre Amii et Communitech vise à stimuler l'adoption de l'IA

Amii annonce sa collaboration avec Communitech, un centre d'innovation de la région de Waterloo, afin de fournir aux fondateurs de startups les outils et les ressources d'IA dont ils ont besoin pour intégrer l'IA et développer des capacités internes avec succès. La collaboration s'appuiera sur l'expertise et les ressources d'Amii en matière d'IA et sera centrée sur le programme d'exploration de l'apprentissage automatique (ML Exploration) d'Amii.